Redes sociales y menores

Introducción

La expansión de internet y más recientemente, la de los teléfonos inteligentes, ha transformado profundamente la vida cotidiana, incluyendo la de las personas menores1,2. Hoy, gran parte de la socialización adolescente ocurre en entornos digitales3–5: las redes sociales se han convertido en importantes espacios de encuentro, expresión y exploración6–9. Su uso es generalizado y comienza a edades cada vez más tempranas5. En ellas, los adolescentes se comunican, aprenden, se divierten y construyen su identidad4,10–12 de formas aún poco comprendidas y con consecuencias difíciles de generalizar4,6. Para muchos adolescentes, sus vivencias en internet y en el contexto presencial se hibridan y forma un continuo que determina una única realidad psicológica12,13. Las experiencias en uno, como la amistad o la violencia, permean el otro y transforman su forma de ver la vida 3,14,15. Esta realidad se moldea a través de la interacción continua entre las necesidades de desarrollo del menor y la manera en que ellos y ellas configuran su experiencia en línea12,13,16–18. De esta interacción surgen las oportunidades6–8 y riesgos3,14,15,19,20 que encuentran o crean en línea. Estos últimos pueden interferir con su bienestar, su salud o con derechos fundamentales como la privacidad.

Diversos estudios y organismos han alertado sobre posibles efectos adversos, especialmente sobre la salud mental6,21. En 2023, el director de Sanidad de EE. UU. emitió una alerta pública5, que fue seguida de demandas judiciales22 de estados23 y escuelas24 a grandes plataformas en ese país. También preocupa la recopilación masiva de datos personales (sobre la que existe una limitada comprensión por los menores o sus familias) pues esta debilita su privacidad y permite influencias comerciales que afectan a sus decisiones, comportamientos y bienestar22,25. En España, también en 2023, se propuso desde la sociedad civil un Pacto de Estado26 para proteger a los menores en el entorno digital27. Con un amplio respaldo institucional y social, ha actuado como punta de lanza en la materia27. Poco después, en 2024, la Fiscalía General del Estado, también puso el foco sobre el tema28 y hasta hoy, a nivel nacional e internacional, se ha intensificado la atención sanitaria, legal, y social4,29–33. Países como Australia, Francia, Estados Unidos o Reino Unido han comenzado a adoptar políticas y medidas regulatorias destinadas a reforzar la seguridad digital del menor34, lo que también se observa en el marco europeo y nacional. Todas ellas se encuentran detalladas en el dosier de la Dirección de Documentación, Biblioteca y Archivo del Congreso de los Diputados34, a colación del Proyecto de Ley Orgánica para la protección de las personas menores de edad en los entornos digitales presentado este 202535.

Aunque existe consenso sobre la necesidad de actuar, persisten debates sobre la idoneidad de algunas medidas y la solidez de la evidencia que las respalda7,32,36. Aun así, la comunidad experta coincide en que garantizar los derechos y el bienestar de las personas menores es un imperativo social y legal37, que debe alcanzarse sin limitar su desarrollo ni su participación digital y sin asumir riesgos injustificados7,27,30,32.

¿Qué es una red social?

Existen múltiples definiciones de red social, sin un consenso generalizado al respecto8,38. De hecho, tratar de acotar un tipo de servicio digital de naturaleza extremadamente cambiante y fluida es complejo. Además, desde una perspectiva reguladora, puede limitar el alcance de las normas e impedir flexibilizarlas frente a su constante evolución (la incorporación de la inteligencia artificial o nuevas funciones y diseños, entre otros)39,40. Por ejemplo, muchas de las funciones de las redes sociales (crear un perfil, conectividad e interacción con otros usuarios, mensajería, reacciones “me gusta”, recomendaciones algorítmicas de algún tipo, etc.) están presentes en juegos en línea, aplicaciones de compra, buscadores u otros servicios que, a su vez, pueden ser parte de las redes sociales41–43.

Las redes sociales son servicios digitales que en su concepción ofrecen importantes oportunidades, sin ser intrínsecamente buenas o malas. Sin embargo, el modelo de negocio de las entidades que sustentan las principales redes sociales del mercado digital actual está orientado42,44 hacia la maximización de beneficios económicos derivados de la participación de los usuarios, sin atender otros intereses30,45.

Por todo ello, más allá de definirlas o poner el foco en la denominación del servicio, es importante atender a las funcionalidades o conjunto de ellas que, sin ser necesariamente específicas o únicas en redes sociales, pueden suponer un riesgo o requerir regulación44.

El uso de redes sociales (no implica saber usarlas)

En España, las personas menores acceden de forma cotidiana a redes sociales desde edades cada vez más tempranas. Muchas veces, lo hacen antes de la edad mínima de acceso sin consentimiento paterno (en España, los 14 años) mediante autodeclaraciones y sin sistemas de verificación de edad efectivos27,46. En cualquier caso, este umbral para prestar el consentimiento sobre su tratamiento de datos y, por ende, para poder acceder a las redes de forma independiente, responde a criterios legales derivados tanto de la Ley de Protección de Datos como de la incapacidad del menor para firmar contratos (lo que en la práctica supone la adhesión a una red social). No obstante, esto no implica que el hecho de tener 14 años garantice por sí mismo un uso seguro47,48.

El smartphone es su vía preferida de acceso19 a las redes sociales y, a los 12 años, el 69 % ya tiene móvil propio49, según datos del Instituto Nacional de Estadística. Otros estudios elevan esta cifra a más del 90 % a los 11 años10,50. Informes independientes a nivel nacional, como el de UNICEF (2021)50, señalan que la presencia de los menores en, al menos, una red social es mayoritaria a partir de los 11 años (>95 %). Tres de cada cuatro los están en más de dos. Respecto a la intensidad del uso, la encuesta europea EU KIDS online (2020) identifica una clara estructuración por edad: la proporción de menores que usa a diario redes sociales es del 20 % entre los 9-11 años, el 48 % entre los 12-14 y el 53 % entre los 15-1619.

Entre las múltiples plataformas, YouTube, Instagram y TikTok son las más usadas, aunque el porcentaje concreto varía entre estudios50–52. Además, en una misma red, muchos menores gestionan múltiples cuentas: para la familia, para amistades o anónimas para expresarse con mayor libertad29,46. Los fines (divertirse, entretenerse, mostrarse, comunicarse, etc.) y usos pueden ser muy variados: algunos de los más reportados son chatear, ver videos, compartir fotos y videos propios o seguir a gente y curiosear50.

En una minoría de casos, el contacto con redes comienza entre los 6 y 8 años o incluso antes, principalmente a través de las cuentas y dispositivos de sus padres7,53. Prácticas como el sharenting7,54 exponen a las personas menores desde etapas muy tempranas, aunque el uso más intensivo y social por parte del menor suele iniciarse a partir de los 9-10 años3. Por debajo de esa edad, el uso de redes se centra en el entretenimiento, especialmente en plataformas como YouTube3. Por ello, los estudios sobre redes sociales por debajo de 9-10 años son escasos y se enfocan más en el uso general de pantallas8,53, un término vago y cuestionable para parte de la comunidad experta55, y que este informe no pretende abordar.

Aunque los adolescentes (a partir de 10 años) están familiarizados con las plataformas, muchos carecen de habilidades para gestionarlas con seguridad19,56. La falta de alfabetización digital y mediática, junto con la inmadurez para modular su uso, los hace especialmente vulnerables. Además, otros factores intrínsecos al contexto digital podrían amplificar los riesgos y fomentar la normalización de conductas que no asumirían en contextos presenciales57. Así, el anonimato y la despersonalización, que pueden favorecer aspectos como la libertad de expresión, también puede asociarse con sensación de distancia, seguridad, desinhibición y falta de empatía entre usuarios58. La inmediatez y la falta de límites (espaciales o temporales) puede facilitar la interconexión o el acompañamiento, pero también trasladar riesgos, como el acoso o bullying, fuera del ámbito escolar durante las 24 horas15,59. La difusión masiva, el rastro digital permanente y la escasa supervisión amplifican la exposición15,59.

El bien superior del menor

El principio del interés superior del menor (Convención sobre los Derechos del Niño60) establece que sus derechos deben ser prioritarios en cualquier decisión que les afecte, lo que incluye el ámbito digital27 (Observación General 2561). Aunque se ha podido considerar un principio general y abstracto, su inclusión en 2021 en el Ordenamiento Jurídico (Ley Orgánica 1/1996 de Protección Jurídica del Menor, art. 2) lo perfila y le proporciona concreción y eficacia normativa62.

Este enfoque reconoce a niños, niñas y adolescentes como sujetos de pleno derecho, más allá de una visión exclusivamente protectora27: exige garantizar su protección, participación, privacidad, bienestar, libertad de expresión o acceso equitativo, entre otros, en los entornos digitales8,27. Se trata de un área de trabajo e investigación en pleno desarrollo que cuestiona las visiones restrictivas del acceso digital de los menores63–65.

La Agencia Española de Protección de Datos (AEPD) señala que el derecho al acceso a entornos digitales no implica que, para su ejercicio, se deban aceptar condiciones o diseños que pongan en peligro la seguridad, privacidad o la integridad física y mental de sus usuarios, independientemente de su edad43,45. Que el acceso suponga la aceptación de condiciones que pueden devenir en esos perjuicios genera tensiones artificiales entre derechos. No obstante, parte de la comunidad experta señala la importancia de no caer en soluciones simplistas, pues no existe una fórmula universal27,28: prohibir o restringir el acceso a redes sociales, aunque bienintencionado, puede también ser contraproducente4,7,66.

Por ello, el personal experto consultado y organismos internacionales como la ONU, OCDE o la UE resaltan la importancia de un enfoque integral que equilibre protección y autonomía27. Se aleja de marcos regulatorios como el del tabaco, en el que los daños son claros y superan cualquier beneficio, y se acerca a la gestión del riesgo propia de ámbitos como la circulación vial66: ante un riesgo percibido como inevitable, se crean normas, entornos seguros, límites etarios, formación, concienciación, etc. para un uso seguro7,27,32,36.

Oportunidades y riesgos en un contexto de incertidumbre

Poner en valor las oportunidades

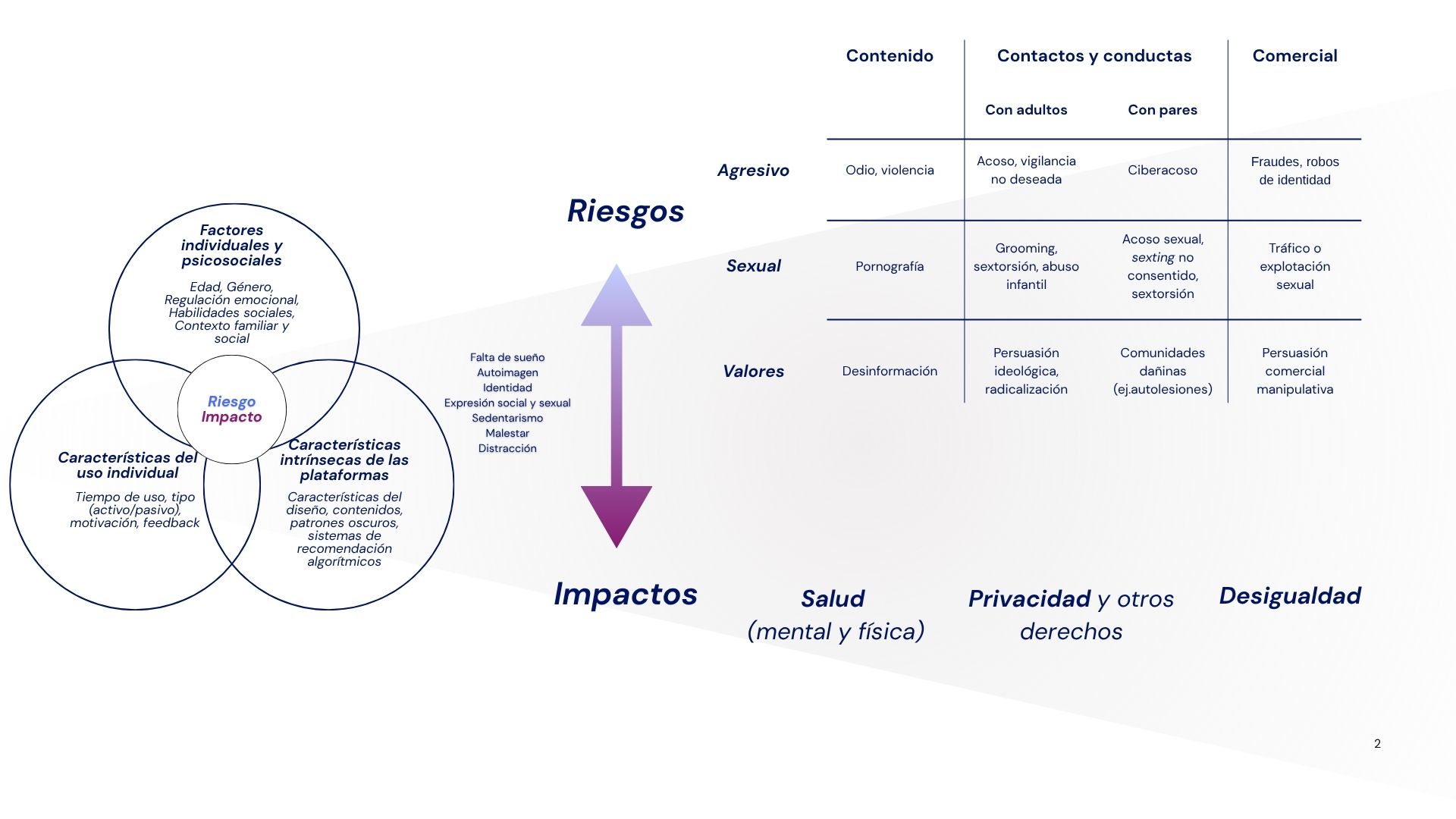

La relación entre el diseño y uso de las redes sociales y el bienestar adolescente es compleja y depende de múltiples factores, como muestra la Figura 15,6,18,67. Cada experiencia digital es única y está modulada por aspectos tanto en línea como fuera de ella4,6,8,68,69. El balance o potencial impacto (positivo, negativo, neutro o mixto) derivado del uso responde así a una visión multifactorial compleja (Figura 1).

Los riesgos digitales suelen clasificarse por su origen (sistema 4C: contenidos, contactos, conductas o aspectos comerciales) y por su naturaleza (violenta, sexual o relacionada con valores sociales)8. También existen riesgos o impactos transversales sobre el bienestar, la salud mental y física y algunos derechos del menor4,6,8,21,69,70 (Figura 1). Más recientemente, se han incorporado otros, derivados de la seguridad y la protección, del uso de tecnologías avanzadas como la inteligencia artificial o del mal uso o uso indebido de la tecnología71. Es importante entender que buena parte de las consecuencias negativas que pueden sufrir las personas menores (ver sección Impactos sobre el bienestar y la salud) se producen principalmente a través de mediadores clave, como el sueño, la autoimagen, el desarrollo de la identidad y la expresión social y sexual72 (Figura 1).

La comunidad experta insiste en la importancia de no perder de vista las oportunidades que las redes sociales pueden ofrecer para el desarrollo social e intelectual durante la adolescencia o en etapas previas4,7,68. Su participación digital permite, desde su forma más básica a la más completa, el entretenimiento, el aprendizaje, la socialización y el ejercicio de la ciudadanía y los derechos digitales17,73. Su empleo puede responder a necesidades fundamentales de los adolescentes, como la pertenencia o el reconocimiento14. Permite explorar la identidad, la autoexpresión, las relaciones sociales, la intimidad y la sexualidad, el aprendizaje, la autonomía y el control, pues es un espacio donde pueden tomar sus propias decisiones12,74. De hecho, es importante matizar que pueden simultáneamente satisfacer unas necesidades y frustrar otras, o ambas cosas a la vez sobre una necesidad concreta (una publicación en una red puede satisfacer la autonomía, pero a la vez frustrarla si se experimenta falta de control debido a un uso compulsivo)75.

A pesar de que muchos estudios encuentran una relación negativa entre el uso de redes sociales y el bienestar de niños, niñas y adolescentes76, algunos también vinculan su uso con mayor bienestar, autoestima, conexión social o apoyo emocional, entre otros aspectos6,74,77,78, algo que los propios menores tienden a reportar50. Las redes pueden ser especialmente relevantes en el caso de colectivos vulnerables, como las personas LGTBIQ+ entre otros, que encuentran espacios de pertenencia, exploración de la identidad, anonimato si es necesario y apoyo79–82. También pueden ser útiles para promover conductas saludables83, acceder a asistencia profesional79,84 o romper estigmas relacionados con la salud mental79.

Los potenciales beneficios derivados de las oportunidades no se materializan de forma automática. Como los efectos negativos asociados a los riesgos, están modulados por el acompañamiento, la educación, la regulación y la protección digital adecuados a la edad; además, dependen de múltiples factores85 (Figura 1) y aún existen limitaciones sobre su comprensión.

Limitaciones y dificultades que requieren especial consideración

Existe un amplio consenso en que la evidencia científica actual no permite establecer relaciones causales generalizables respecto al uso de redes sociales y sus efectos6–8,18,21,40,44,67,86–88. No obstante, algunas interpretaciones sostienen que este hecho no implica que no existan89. Se apoyan principalmente en correlaciones y ponen el foco en la coincidencia entre el deterioro progresivo de la salud mental de los adolescentes detectado en los últimos 20 años y la llegada y asimilación del móvil y las redes sociales88,90. Independientemente, diversos estudios y organismos advierten que esta incertidumbre no debe justificar la inacción27,40. Al contrario, debe impulsar políticas matizadas, proporcionales al conocimiento disponible y sometidas a estricta evaluación4,40.

Existe cierto consenso en la evidencia disponible: muchos estudios y metaanálisis encuentran una relación negativa entre el uso de redes sociales y el bienestar de niños, niñas y adolescentes76. Sin embargo, la mayoría son estudios correlacionales, con asociaciones débiles en muchos casos y a veces existen resultados contradictorios (un mismo indicador mejora, empeora o no hay efecto según el estudio)18,91–93. De hecho, la multifactorialidad (Figura 1) se asocia con la gran heterogeneidad de resultados y dificulta aislar el efecto de las redes frente a otros factores como el entorno familiar, escolar o cultural6,32,40,44,85,88,94. Además, existe evidencia que apunta a una posible bidireccionalidad: en muchos casos, el malestar psicológico (u otras condiciones) lleva a un uso más intensivo o problemático de redes, y no solo al revés6,78,95–99.

Las investigaciones enfrentan importantes obstáculos metodológicos: falta de acceso a datos reales de las plataformas (la mayoría se basan en autorreportes de usuarios), muestras poco representativas44,67, escasez de estudios experimentales o longitudinales (para comprender la evolución y posible reversibilidad con el tiempo)6–8,21,67,69 o disensos conceptuales6,21. La evidencia de los escasos trabajos longitudinales también es inconcluyente69: muestra tanto una influencia negativa sobre el bienestar (por ejemplo síntomas depresivos)100–103 como falta de ella o bidireccionalidad, según el estudio104–109. A esto se suman obstáculos como el ritmo acelerado de cambio tecnológico o la constante actualización y personalización algorítmica, que dificultan la capacidad de la ciencia para generar conocimiento y aplicarlo, ya que estrechan la ventana de oportunidad para ello6,40,110.

La falta de datos que limita la comprensión del fenómeno se relaciona con la opacidad de las plataformas111: no comparten sus propios estudios (incluidos los relativos a los efectos en la salud en personas menores o los test AB que aplican)40 ni los datos necesarios, lo que dificulta la evaluación del impacto real de sus diseños y la transparencia algorítmica.

Por todo ello, en la actualidad, existen muchas dificultades para poder establecer relaciones causales claras entre características de las redes y efectos sobre la salud de los niños, niñas y adolescentes40,87, sin que eso signifique la ausencia de conocimientos y mecanismos para la acción27,40, tal y como recalca la comunidad experta.

Actuar más allá de la incertidumbre

Ante estas limitaciones, parte de la comunidad científica advierte que exigir evidencia causal robusta y generalizable es poco realista4,40. La falta de certeza no implica ausencia de daño4,18,31,112,113 y puede ocultar impactos relevantes, especialmente en subgrupos vulnerables27,88. Cuando la evidencia llega tarde, los daños pueden acumularse, a la vez que algunos temores infundados pueden potenciar la alarma social y el pánico moral, lo que puede desembocar en decisiones precipitadas32,36,40,69,88,114 con efectos no deseados69. En este contexto, casos bien documentados115 o la experiencia de profesionales que trabajan con menores, como profesorado, pediatras, psiquiatras o psicólogos, y otros actores clave como las familias, requieren atención ya que refuerzan y pueden orientar la necesidad de actuar4,27,40,116. El reciente informe del Comité de personas expertas para el desarrollo de un entorno digital seguro para los menores señala un buen grado de consenso entre estos profesionales en España respecto a la necesidad de actuar ante los riesgos digitales27.

La Comisión Europea reconoce la legitimidad de intervenir incluso sin evidencia perfecta (principio de precaución)117, siempre que se valoren cuidadosamente los riesgos: ¿es más arriesgado no hacer nada o intervenir con cierto grado de incertidumbre? No todos los impactos son igual de importantes69,118 ni igualmente reversibles40. Por ello, parte de la comunidad experta propone mecanismos para reducir el umbral de evidencia mínima para intervenir, mientras el conocimiento avanza40. Pueden inspirarse en sectores como la seguridad alimentaria o productos infantiles como los juguetes, donde existen mecanismos (agencias de control, organismos, etc.) y obligaciones para que las empresas demuestren que sus servicios son seguros y que cumplen con el marco legal (auditorías, evaluaciones de riesgos, impactos, etc.). Esto permitiría detectar señales tempranas de daño, priorizar áreas de intervención y fomentar alternativas más seguras40.

Ante la incertidumbre, varios expertos proponen un enfoque pragmático centrado en proteger y promover conductas diarias que cuentan con evidencia clara sobre sus efectos saludables en el desarrollo y rendimiento de niños y adolescentes, como dormir entre 9 y 11 horas, una hora de actividad física diaria, cultivar conexiones sociales significativas fuera de línea y desarrollar las competencias socioemocionales para la vida40,75,119,120.

Del individuo a las plataformas: factores clave

Edad, género y otros factores individuales y sociales relevantes

La adolescencia es una etapa de intensos cambios físicos, tanto hormonales como neurocognitivos, y socioemocionales que influyen en cómo se usan y experimentan las redes sociales6,44,68,121,122 (Cuadro 1). La sensibilidad a sus efectos es mayor que en cualquier otra etapa y varía según la edad: los más jóvenes (10-15 años) son los más vulnerables95.

En términos de género, los efectos negativos son más comunes en chicas3,6,8,19,32,90. El personal experto lo relaciona, en parte, con una pubertad más temprana94 (Cuadro 1) y un uso, comparado con los chicos, más centrado en la imagen y las relaciones sociales. Además, este reproduce desigualdades de género6,81,136,137 e incluye distintas formas de violencia digital de género138. Una importante parte de los estudios señala una mayor exposición al uso de tipo problemático10,139 y a la presión estética, con insatisfacción corporal o el uso de filtros, entre otros aspectos11,95,140–144. De igual manera, se ven afectadas más habitualmente por el acoso o la difusión no consentida de imágenes íntimas145–147, lo que en conjunto, conlleva consecuencias graves para su bienestar27. También hay que considerar que gran parte de la investigación se ha enfocado en problemas internalizantes, en particular, depresión y ansiedad, que pueden amplificar las diferencias por género, ya que son más prevalentes en mujeres por factores tanto biológicos como de socialización148.

Cuadro 1: Adolescencia y redes sociales: una etapa de especial sensibilidad y predisposición

La evidencia sugiere que la sensibilidad a los efectos de las redes sociales varía según la etapa del desarrollo. Es especialmente alta entre los 11 y 13 años, en niñas, y entre los 14 y 15, en niños94, coincidiendo con los cambios puberales, que empiezan antes en las niñas123.

Durante la adolescencia, el cerebro sigue madurando122,124,125. Algunas regiones del cerebro encargadas del control de impulsos y la toma de decisiones (control cognitivo y emocional), como los circuitos frontoparietales, están completando su desarrollo. Mientras, otras como el sistema límbico o el sistema de recompensa, ya están particularmente sensibilizadas126,127. Este desarrollo neurobiológico en marcha se traduce en un cerebro especialmente sensible o inclinado a valorar más el impacto social, emocional y el corto plazo en la toma de decisiones, lo que influye en la percepción y asunción de los riesgos que caracterizan el periodo (por ejemplo, compartir imágenes personales, retos virales, etc.)68,128,129.

Junto a los cambios biológicos, también se producen cambios sociales: para los adolescentes, la opinión de sus iguales pasa a cobrar mayor importancia que la de la familia. Esto aumenta su sensibilidad a la exclusión social126,130,131, incluso, en los entornos digitales132. Se trata, por tanto, de un periodo vulnerable, donde aumenta la complejidad de sus relaciones sociales, al mismo tiempo que van desarrollando sus identidades133.

Todo ello dificulta la regulación emocional y el juicio a largo plazo. Se favorece así que experiencias como la comparación social, el estrés, la validación externa o la búsqueda de recompensa inmediata6,134 puedan tener un impacto más profundo en los adolescentes que en los adultos, o sean más difíciles de manejar44. De hecho, es también un periodo de mayor riesgo para el desarrollo de trastornos de salud mental y adicciones, tanto conductuales como a sustancias44,135.Por todo ello, parte de la comunidad experta destaca la importancia de valorar si conceptos como el de uso responsable de las redes tiene sentido en esta etapa, dadas sus particularidades cognitivas y emocionales27.

Conviene señalar que tanto chicos como chicas pueden sufrir los riesgos descritos. Además, los trabajos que contemplan categorías no binarias entre los adolescentes señalan que estos enfrentan con mayor frecuencia múltiples riesgos digitales149–151.

Otros factores individuales, como la capacidad de autorregulación emocional6, las habilidades sociales152 o ciertos rasgos de personalidad6, pueden actuar como factores de riesgo o protección, según el caso. La soledad, por ejemplo, puede ser tanto causa como consecuencia del uso de redes78,83,95. La presencia de dificultades o trastornos de salud mental subyacentes es otro factor que puede amplificar los riesgos12,98. También influyen el entorno y el acompañamiento familiar6: desde edades tempranas, los y las menores imitan el uso que hacen sus padres de la tecnología153,154. Asimismo, las desigualdades socioeconómicas pueden configurar una brecha digital que afecta a tres niveles: acceso a dispositivos, habilidades para interactuar en línea y la capacidad de extraer beneficios y afrontar los riesgos del mundo digital4,155,156. Las personas menores con bajos recursos pueden tener un acceso limitado a dispositivos, normalmente más inclinado a poseer móviles, y una menor alfabetización digital, lo que limita su capacidad para beneficiarse de forma segura de la tecnología. Aunque algunos estudios señalan diferencias en los patrones de uso según el nivel económico, la evidencia sobre cómo este factor influye en el uso y bienestar a largo plazo no es aún robusta92.

Tipo de uso: del cuánto al cómo y para qué

Mientras que un tiempo de uso superior a 2 horas diarias se relaciona con efectos negativos, la exposición por debajo de ese umbral suelen asociarse con beneficio en los adolescentes6,154,157. Los datos en España señalan que casi la mitad de menores de entre 11 y 19 años superan las 2 horas51. Entre los 11 y los 14 años, se estima un consumo medio diario de 3,59 horas para ellas y 2,3 horas para ellos10. Aunque algunos trabajos relacionan el tiempo de uso y los efecto negativos mediante la hipótesis del desplazamiento (cuanto más tiempo se dedica a redes, menos se invierte en actividades protectoras como el sueño, el ejercicio, la comunicación en persona etc.)79,80,142, la evidencia al respecto aún requiere ser reforzada para confirmarlo158–160.

Sin embargo, no basta con contar horas: el tipo de uso y su contexto son igual o más relevantes6,8,44,69,157. Muchos estudios señalan beneficios asociados a un tipo de uso activo6,83,96 y más perjuicios en el caso del uso pasivo6,10,83,161. Sin embargo, algunos autores consideran que esta dicotomía es demasiado simplista y señalan que la evidencia que la respalda es inconsistente162–164. Aunque no se pueden perder de vista los múltiples usos positivos que existen (sección Poner en valor las oportunidades), se observa con frecuencia un uso instrumental y compensatorio que puede apoyarse en la gratificación derivada de la recompensa inmediata que ofrecen (“me gustas”, entretenimiento, estatus). Así, las redes se convierten en espacios para regular emociones, aliviar el aburrimiento, el miedo a perderse algo (FOMO, por sus siglas en inglés) o buscar aprobación6,12,165. Cuando son el principal mecanismo de regulación emocional, el riesgo de efectos negativos aumenta6,10,83,161. Además, factores como la respuesta que reciben los adolescentes de otros usuarios --apoyo, rechazo o indiferencia-- o los riesgos que experimentan (Figura 1) influyen directamente en su bienestar6,85,166,167. En España, algunos datos señalan que uno de los principales motivos entre adolescentes (11-15 años) para estar en redes es saber qué opinan los demás sobre ellos y compararse10.

Un modelo de negocio diseñado para captar y capitalizar la atención

El diseño de las plataformas digitales no es neutral: responde a un modelo de negocio basado en captar y retener la atención del usuario, maximizar el tiempo de uso (hacerlas “inevitables”) y recopilar así datos para su análisis y monetización directa (su venta) o mediante publicidad42,168–171 (INFORME C)169.

Para ello, las plataformas emplean patrones de diseño persuasivo, a menudo, denominados adictivos, engañosos u oscuros, basados en principios de la psicología del comportamiento y la economía conductual con el fin de influir en el comportamiento del usuario172 (Cuadro 2). Estos patrones explotan sesgos cognitivos y vulnerabilidades emocionales. Activan, además, circuitos neurales de recompensa mediante distintos elementos de su diseño6,134,157,172–175 (Cuadro 2) para aprovecharse de las preferencias naturales del individuo. Por ejemplo, reducir el malestar (aburrimiento, ansiedad, etc.) en un “bucle lúdico176” es un importante mecanismo de recompensa inmediata (refuerzo negativo) que puede asociarse con conductas compulsivas y problemáticas (autolesiones, consumo de sustancias, uso problemático de internet, etc.). La capacidad de impacto de los patrones de diseño también radica en las posibilidades de uso que el usuario percibe como disponibles (affordances), es decir, cómo los adolescentes interpretan y usan sus funciones44.

Las posibilidades de uso o acción por parte de los adolescentes pueden actuar como señales sociales y generar presión o favorecer el malestar o la exposición a riesgos44,177. Algunas de ellas44, como la cuantificación (“me gusta”, número de seguidores, etc.), amplifican la comparación social. El autoconcepto y la autopercepción se ven alteradas por la editabilidad, que permite proyectar la imagen que se desea aunque no sea la real (usar filtros, por ejemplo11). Asimismo, la personalización de mensajes y contenidos, por parte del emisor o por recomendación algorítmica, determina lo que los jóvenes ven en sus redes sociales y modifica sus percepciones. Otras, como la replicabilidad, permiten capturas de pantalla, incluso en cuentas privadas o servicios de mensajería, que pueden impactar la privacidad. El anonimato, por su parte, puede influir sobre el comportamiento (asumir más riesgos). Mientras, la disponibilidad constante de estímulos potencia la recompensa intermitente y, si se refiere a los usuarios, puede redefinir conceptos como la amistad ya que genera nuevas expectativas, presiones y tensiones de disponibilidad o repuesta que pueden afectar negativamente a las relaciones entre adolescentes178: “un amigo contesta a cualquier hora y rápido”.

Cuadro 2. Patrones oscuros o manipulativos para la persuasión

Captación de la atención6,7,168,179–181. Persiguen mantener a los usuarios ocupados y entretenidos el máximo tiempo posible (estrategias de compromiso o atención continua). Lo logran mediante hábitos adquiridos por repetición que fomentan el uso compulsivo gracias a recompensas variables e impredecibles --por ejemplo, los “me gusta”, doble confirmación de lectura, el scroll infinito y "pull-to-refresh" o el autoplay--. También se incluyen sistemas que generan una interferencia cognitiva para reducir la capacidad de decisión deliberada: notificaciones emergentes (push), explotación del FOMO mediante indicadores de tendencia o urgencia (“¡5 de tus amigos están viendo esto ahora!”), temporizadores de oferta o mensajes de contenido que desaparecen pronto, gamificación, o, directamente, la saturación sensorial168.

Personalización algorítmica. El tipo de contenido al que se exponen los menores influye directamente en los riesgos que enfrentan8, pero su control sobre lo que ven es limitado10. Los algoritmos priorizan aquello que genera más atención, incluso, si es perjudicial, reforzando así el uso continuo10. A partir de sus interacciones (búsquedas, “me gusta”, tiempo de visionado, etc.), se diseñan recomendaciones (contactos, contenidos, un feed específico, etc.) personalizadas que refuerzan intereses y explotan emociones o vulnerabilidades, con estrategias como la sugerencia de cuentas o contenidos similares6,7,33,168,179–181. Estas prácticas pueden influir en su pensamiento y en sus relaciones sociales (framing) o manipular el proceso de pensamiento intuitivo33. Aunque puede que no fuera el objetivo inicial de los algoritmos de recomendaciones, estas consecuencias puede que imprevistas son motivo de gran preocupación. Por ejemplo, algunos estudios relacionan la influencia de los algoritmos de plataformas como TikTok con un agravamiento de trastornos existentes en adolescentes, como los de la conducta alimentaria182, o incluso con la aparición de síntomas psiquiátricos183.

Barreras a la autonomía (estrategias de control)180. Son configuraciones que manipulan las decisiones del usuario. Dificultan opciones importantes, como borrar cuentas o cambiar la privacidad168. Entre otras características, incluyen navegación laberíntica (configuraciones de privacidad y de eliminación de cuentas difíciles de encontrar e interfaces engañosas que promueven la permanencia por frustración o desorientación) y condiciones redirigidas (como obligar a aceptar condiciones como permisos de acceso innecesarios para desbloquear funciones básicas, períodos de gracia --30 días-- forzados al intentar borrar cuentas, etc.)6,7,168,179–181.

El diseño no solo condiciona el comportamiento del usuario, sino que también transforma sus datos en un bien monetizable. Las plataformas recopilan información personal de forma activa (mediante consentimiento), pasiva (por navegación), inferida (a partir de patrones de uso) o por parte de terceros, y la utilizan para personalizar la experiencia y maximizar la atención42,168. La Agencia Española de Protección de Datos (AEPD) ha advertido que muchas de estas prácticas carecen de un propósito legítimo y pueden vulnerar derechos fundamentales como la integridad45, la autonomía o la libertad individual (Cuadro 2)42. Se trata de entornos que no consideran adecuadamente las necesidades o capacidades de las personas menores que los usan, generan riesgos específicos para esta población8,27,33,42 y favorecen un uso problemático (sección ¿Uso problemático o adicción?)6,168,172. La AEPD ha recogido recientemente bajo la denominación de patrones adictivos los múltiples riesgos de infracción normativa (relacionados con transparencia, segmentación y perfilado, protección de datos por diseño y defecto, licitud, minimización o limitación de la finalidad, entre otros), en los que pueden incurrir estos mecanismos (Cuadro 2)42.

El diseño de las plataformas digitales evoluciona continuamente, pero lo hace para responder al modelo de negocio6. Aunque ya se han identificado numerosas prácticas manipulativas, se trata de un campo emergente en el que sigue faltando evidencia que relacione una característica concreta con efectos específicos, especialmente en colectivos vulnerables, que suelen ser los más afectados por estos diseños184–186. Comprender estas interacciones entre diseño, percepción, contexto, y efectos es clave para identificar los riesgos reales asociados a ciertas funciones de las plataformas44,177.

El Parlamento Europeo ya ha adoptado una resolución187 que persigue prohibir el uso de algunos patrones manipulativos (Cuadro 2) y existen iniciativas similares en otras regiones42. No obstante, el marco regulatorio de la UE en este terreno sigue fragmentado y carece de una definición unificada188. Esto genera inseguridad jurídica y aplicación desigual entre países y sectores. Actores del ecosistema y la academia reclaman definiciones más claras, salvaguardas más robustas y una ejecución más efectiva de la normativa vigente188. La Comisión trabaja en la futura Ley de Equidad digital (actualmente en fase de consulta abierta) con el objetivo de abordar estos retos y las prácticas perjudiciales asociadas al diseño que sufren los consumidores189.

¿Uso problemático o adicción? La importancia de mirar más allá de la tecnología

Aunque se habla con frecuencia de “adicción a las redes sociales”, la comunidad científica prefiere el término uso problemático, entendido como una pérdida de control sobre el uso a pesar de que el individuo reconoce sus consecuencias negativas14,27,168,190,191. Este patrón afecta a una minoría de adolescentes, en torno al 4 % de media; en España hay estimaciones que oscilan entre el 3 %139 y el 8,4 %10. Aunque algunos estudios europeos sugieren un aumento del riesgo de uso problemático desde la pandemia192, los datos en España muestran un ligero descenso en su prevalencia entre los adolescentes en el periodo 2021-2023 (hasta un 4 %, dependiendo de la edad en la horquilla 14-17). Tiene mayor prevalencia entre chicas10 y son muchos los efectos adversos asociados10,192–194. En los casos más graves, puede asemejarse a una adicción conductual, aunque, a diferencia de la adicción a los juegos de azar, en línea o no (reconocido en la Clasificación Internacional de Enfermedades CIE-11195 y el Manual de los Trastornos Mentales DSM-5196 de la Asociación Americana de Psiquiatría) o la adicción a los videojuegos (CIE-11195), no está reconocida como tal135,168.

En este contexto, es común utilizar el lenguaje propio de las adicciones a sustancias, con expresiones desproporcionadas como “cocaína digital”. Sin embargo, el modelo biomédico y psicológico de estos trastornos no permite una extrapolación directa al caso de las redes197. Existen similitudes, como la activación del sistema (dopaminérgico) de recompensa cerebral y la búsqueda de gratificación inmediata190,198–200 (otras formas de lograr la satisfacción de este impulso son comer o mantener relaciones sexuales, por ejemplo). Parte de la comunidad experta destaca que se trata de sistemas evolutivamente adaptativos para una socialización beneficiosa pero que, en el contexto del modelo de negocio de las redes sociales actuales, pueden conducir a comportamientos maladaptativos, como el uso problemático. Se habla así de la “inevitabilidad” del riesgo que suponen las redes sociales tal y como son ahora201,202. Por otro lado, otros elementos clave de los trastornos por adicciones, como el síndrome de abstinencia o la tolerancia, no se ajustan bien al modelo biomédico (carecen de marcadores fisiológicos claros, por ejemplo) en el caso de las redes sociales y se redefinen sin un consenso claro197.

Ante este panorama, parte de la comunidad experta plantea que el uso problemático puede ser más un síntoma que una causa: una expresión de malestar emocional o relacional no resuelto por otras vías. De esta forma, se potencia el uso de las redes para satisfacer necesidades profundas (estatus, alivio emocional, etc.), es decir, un uso compensatorio o destinado a cumplir funciones subjetivamente útiles203. Esto explicaría su fuerte vínculo con trastornos afectivos, baja autoestima o ansiedad197. Desde esta perspectiva, la dificultad para regular el uso se asocia fuertemente con el papel que la tecnología cumple en la vida del menor y no solo a su diseño o carácter adictivo de la tecnología, algo de un peso indiscutible en el caso de las sustancias. Además, evidencia la posibilidad de generar riesgos individuales específicos basados en explotar las vulnerabilidades socioemocionales mediante prácticas como la personalización algorítmica (Cuadro 2) con fines comerciales (sección Contrato, privacidad y explotación comercial).

Por tanto, sin perder de vista la fuerte influencia del entorno digital que crean las grandes plataformas y su modelo de negocio, es necesario atender también a los factores emocionales, familiares, sociales o escolares ampliamente reconocidos como determinantes de la salud mental infantil, que pueden estar en la base del malestar: exclusión, desigualdad, soledad, conflictos o abuso203. La prevención, en este caso, no debe centrarse únicamente en modificar la relación con la tecnología, ni seguir estrictamente el marco de las adicciones a sustancias, sino adoptar un enfoque más amplio y personalizado.

Actualmente, no existe una definición única ni un marco teórico estandarizado en cuanto a cómo detectar, medir o diagnosticar la existencia de un uso problemático, aunque se han propuesto distintas escalas e instrumentos192,204. En cualquier caso, se reconozca o no como adicción, la comunidad experta destaca la necesidad de actuar ante el malestar y los posibles efectos asociados. Un pequeño porcentaje de quienes lo padecen llega a necesitar tratamiento especializado; de hecho, en España, ya existen unidades especializadas en algunos hospitales y clínicas135,191.

Riesgos y potenciales efectos asociados al uso de redes sociales en personas menores

Las redes sociales y de mensajería son vehículos centrales de los principales riesgos en línea27 (Figura 1). La evidencia señala que estas experiencias negativas en línea deterioran el bienestar de los adolescentes85. Sin embargo, no todos los niños, niñas y adolescentes que se enfrentan a los riesgos o experiencias negativas en internet sufren un daño o se sienten afectados o molestos. En Europa tan sólo una cuarta parte afirma haberse sentido perturbada tras vivir algo incómodo en línea, lo que se puede asociar con su nivel de resiliencia digital frente a los efectos negativos85 (ver sección Una sociedad más resiliente).

Buena parte de la comunidad experta coincide en agrupar los riesgos en línea para los menores en la clasificación 4C16 --contenidos, contactos, conductas y contrato--, a los que se suman amenazas transversales sobre la salud, privacidad y otras áreas (explicados en la Figura 1). Preocupa también la normalización de dinámicas comunes en redes que pueden distorsionar valores u otros aspectos subjetivos, como la percepción de la afectividad y la sexualidad (por exposición a pornografía extrema) o la libertad de expresión (por discursos de odio)205,206. Estas distorsiones pueden consolidarse en la adultez y reforzar patrones tóxicos, desigualdades o la polarización205.

La Fiscalía General del Estado identifica la intimidad, la integridad física y la libertad sexual como las áreas con mayor incidencia delictiva en menores, con un incremento constante en el entorno digital, en especial, entre adolescentes57,58. Muchos de estos riesgos derivan de la cesión, consciente o no, de datos o imágenes personales57. También se ha detectado un aumento significativo del porcentaje de personas menores que se ven victimizados a través de la tecnología en contextos escolares, sobre todo, por amenazas, extorsiones y delitos sexuales27.

Contenidos

La exposición de menores a contenidos potencialmente dañinos en redes sociales está ampliamente documentada8,19. Sigue dándose, a pesar de las obligaciones legales recogidas en la Ley General de Comunicación Audiovisual207, como señalan informes recientes27. Entre los 12 y 16 años, muchos declaran haber visto contenidos sobre autolesiones, violencia, drogas, discursos de odio o cuerpos extremadamente delgados19. Es importante distinguir entre contenidos ilegales (como material de abuso sexual infantil) y dañinos (como la promoción del autolesiones y conducta suicida, retos virales o desinformación). La normativa británica208 para la protección del menor en línea ha centrado su desarrollo en la regulación de contenidos, lo que puede inspirar acciones similares en otros países (Cuadro 3). También existe alguna propuesta de ley en Estados Unidos que puede ser de interés en este sentido209.

Aunque múltiples factores modulan el riesgo de daño derivado de la exposición a contenidos dañinos, este es más probable a edades tempranas y aumenta con la frecuencia de exposición (efecto acumulativo) y al pasar de ser accidental a intencionada229. En muchos casos, el primer contacto no es intencional, sino resultado de recomendaciones automáticas o reenvío de otros usuarios. El shock y la atención ante estas interacciones iniciales favorecen su amplificación algorítmica y puede generar un ciclo de exposición casi inevitable217,221. De hecho, la comunidad experta advierte que las redes sociales fallan en detectar y eliminar contenidos potencialmente dañinos; al contrario, sus algoritmos (como en X, TikTok o Instagram) tienden a amplificarlos por la atención que generan, sin que exista un control efectivo al respecto21,27 (INFORME C)169.

Actuar sobre estos sistemas (Cuadro 3) y capacitar a los menores para manejar su exposición, especialmente la no intencional, es un reto esencial230. En España, INCIBE y la AEPD ofrecen pautas al respecto30,231.

Cuadro 3. Regular e implementar: la Online Safety Act (OSA) en Reino Unido y la Ley de Servicios Digitales (DSA) en Europa.

La implementación de la recientes legislación orientada a reforzar la protección de los menores en línea constituye un desafío. En Reino Unido, Ofcom, el regulador de comunicaciones británico es el responsable de la implementación, aun en marcha, de la OSA (2023). La norma impone nuevas obligaciones a plataformas y servicios digitales para proteger a los usuarios, especialmente, a las personas menores. Con el apoyo de guías y códigos, orienta a los proveedores para impedir el acceso de menores a contenidos perjudiciales o inapropiados y para ofrecer vías claras para reportar problemas210. La OSA exige que las empresas verifiquen la edad de los usuarios211 y evalúen riesgos específicos según tramos etarios212,213, atendiendo tanto a los contenidos como a los sistemas que los amplifican (algoritmos, diseño, mensajería o grupos)214–217. Los contenidos ilegales (abuso sexual infantil, odio, terrorismo) están prohibidos210. Los dañinos se jerarquizan: los más graves (conducta suicida (INFORME C)218, autolesiones, trastornos alimentarios) deben bloquearse y no recomendarse; otros (discursos de odio, retos peligrosos) requieren medidas proporcionales (por ejemplo, pueden aparecer, pero no amplificarse algorítmicamente)210. En función de los riesgos, las plataformas deben aplicar medidas que inciden en la gobernanza, verificación de edad, moderación de contenidos, sistemas de recomendación, mecanismos de reporte, configuraciones, soporte del usuario y controles mejorados219. Ofcom ha publicado guías sobre verificación de edad220 y otras áreas, entre las que destacan el control de comentarios y la promoción de algoritmos de aprendizaje automático que no amplifiquen contenidos de riesgo221.

Desde el marco europeo, se trabaja actualmente en la implementación de la Ley de Servicios Digitales (DSA)222, que también exige evaluaciones de riesgos y se centra en un enfoque sistémico: las grandes plataformas deben identificar y analizar los riesgos derivados del diseño, funcionamiento y uso de sus servicios223. En este caso, la definición de contenidos ilegales queda en manos de los Estados miembros223. En España, la Comisión Nacional de los Mercados y la Competencia ha sido designada como autoridad nacional competente para la aplicación y supervisión del cumplimiento de la DSA, con participación de la Comisión Europea a nivel supranacional224.

La Comisión acaba de publicar una lista no exhaustiva de medidas para que los proveedores (todas las plataformas accesibles a menores, excepto micro y pequeñas empresas) garanticen un alto nivel de privacidad, seguridad y protección de los menores en línea225. Servirán como referencia para evaluar la aplicación de la DSA y se centran en riesgos específicos, como grooming, contenidos dañinos, conductas problemáticas o adictivas, ciberacoso y prácticas comerciales abusivas226. Se articulan y detallan en torno a varias líneas clave226: cuentas de menores privadas por defecto, ajustes de los sistemas de recomendación para reducir exposición a contenidos y espirales dañinos y mayor control sobre ellos, opciones para bloquear y silenciar a cualquier usuario, consentimiento expreso antes de añadir a un usuario a grupos, prohibición de descargar o hacer capturas de contenidos publicados por menores, desactivación por defecto de funciones que fomentan uso excesivo, mayor protección frente a prácticas comerciales manipuladoras, mejoras en la moderación y herramientas de reporte (retroalimentación ágil, requisitos mínimos para controles parentales). Las directrices incluyen también recomendaciones específicas para el desarrollo de sistemas de verificación de edad226. Se basan en el uso de una nueva cartera de identidad digital europea (en pleno desarrollo)227 que España, junto a otros países europeos, ya está poniendo a prueba, y que en el futuro se espera sea integrada por las plataformas228. También contempla otros métodos, como la estimación de edad, en función del caso225.

Las directrices adoptan un enfoque de riesgo y diseño seguro por defecto, que emplea como brújula los derechos de los menores226. De hecho, las plataformas deben garantizar que las medidas que adopten no restrinjan de forma desproporcionada o indebida los derechos de los menores225.

El discurso de odio es el contenido dañino más común. Se asocia con la polarización, la exclusión y la vulneración de derechos fundamentales230,232. También preocupa especialmente la exposición a pornografía (Cuadro 4) y la desinformación. Esta última implica un riesgo relevante para su bienestar, así como para la confianza en los medios de comunicación tradicionales y la propia democracia, como reconoce la UE233 (INFORME C)169. Las personas menores pueden actuar como distribuidoras (o, incluso, creadoras) y receptoras o dianas, pero también como freno, si cuentan con la formación apropiada233. Muchos adolescentes confían en su criterio, aunque los estudios en España señalan que tienen dificultades para evaluar la veracidad de lo que consumen y comparten8 (INFORME C)169. Es frecuente que compartan contenidos engañosos sin percibir que han sido engañados233, algo que el uso de la inteligencia artificial facilita en la actualidad169. Además, a pesar de que muchos menores sí poseen habilidades para ello, a menudo, comparten contenidos falsos conscientemente como forma de participación social, lo que incrementa su vulnerabilidad y debilita el pensamiento crítico233,234.

Por otra parte, la exposición en redes sociales a contenidos que idealizan la delgadez y promueven estereotipos de belleza inalcanzables21 en redes sociales (por ejemplo, los que surgen alrededor de los hashtags “fitspiration” o “lifestyle”, así como imágenes sexualizada)21 se relaciona con insatisfacción, obsesión corporal, baja autoestima, autocomparación95,143 y trastornos de la conducta alimentaria y depresión67,83,235–239, si bien algunos estudios cuestionan este tipo de efectos a largo plazo69.

Cuadro 4. Imágenes sexuales, sexting: entre la exploración y el riesgo

La comunidad experta destaca, a sabiendas de la dificultad, la importancia de evitar enfoques alarmistas sin matices19,240 y reforzar la educación afectivo-sexual27, siempre ajustada a la edad y las experiencias reales de niños, niñas y adolescentes240 con estos temas. En algunas prácticas como el sexting (entendido como el envío de mensajes, imágenes o vídeos de contenido sexual explícito autogenerado a través de dispositivos electrónicos) se considera que la información disponible es especialmente escasa240.

El acceso a contenidos sexuales en internet o, de forma específica, a través de redes sociales, no siempre es accidental ni negativo: muchos adolescentes los buscan por curiosidad o para comprender su cuerpo y sexualidad19. En España, casi el 75 % de los que han visto este tipo de contenido no refieren malestar19. Sin embargo, cuando la exposición es involuntaria, precoz o forzada (como recibir imágenes sexuales no solicitadas) es más común que tenga efectos negativos59. De hecho, la exposición temprana a la pornografía se relaciona con importantes daños sobre el desarrollo, como una mayor tolerancia al acoso sexual, conductas sexuales de riesgo y la adopción de actitudes perjudiciales hacia las mujeres4,27,29,58,59,206.

En cuanto al sexting, es una práctica frecuente entre adolescentes a partir de los 12 años (1 de cada 5 menores entre 12 y 16 años recibe imágenes sexuales directamente del creador)29,241 que, con independencia de la intencionalidad o de la experiencia de las partes implicadas, conlleva el riesgo de difusión y pérdida de control del contenido19. Puede incluir el acceso de pedófilos a estas imágenes242. La evidencia reciente distingue principalmente entre dos tipos de sexting: formas consensuadas, que pueden ser parte del desarrollo identitario y la exploración sexual, y formas no consensuadas (presión, chantaje, reenvío sin permiso, grooming), que se asocian a consecuencias negativas como malestar, depresión o autolesiones19,240,243,244. Estas últimas se consideran una forma de violencia o abuso sexual digital mediante imágenes. La perpetración del reenvío sin consentimiento entre personas menores muestra patrones preocupantes de repetición en el tiempo, también la victimización (sobre todo, en ellas), lo que subraya la necesidad de intervenir desde edades tempranas245. Así, el debate sobre el sexting adolescente se divide en dos posturas: una que lo considera una conducta normalizada que puede favorecer el desarrollo frente a otra que lo ve como una conducta disfuncional asociada a otros riesgos69,240.

La evidencia reciente destaca la necesidad de abordar el sexting como un fenómeno multidimensional con distintos tipos y significados240,246 y atender el reto de prevenir los riesgos mediante estrategias que no estén desconectadas de las experiencias reales de los jóvenes19. Los entornos educativos rara vez abordan aspectos como el sexting y, cuando lo hacen, suelen transmitir mensajes negativos, punitivos o centrados en evitar la práctica, sin distinguir entre prácticas consensuadas o coercitivas240. Se necesitan estrategias educativas realistas y comprensivas, que promuevan el conocimiento de los peligros asociados, reconozcan la diversidad de experiencias y promuevan el empoderamiento para rechazar conductas con las que no estén cómodos; asimismo, es necesario integrar factores individuales, sociales y cognitivos que pueden amplificar o reducir los riesgos138,240,247. Además, es clave que cuenten con el apoyo coordinado de escuelas, familias y profesionales247 y puedan recibir mensajes normalizados que favorezcan la confianza240. Así, por un lado, se favorece que los menores compartan sus preocupaciones en torno a ello y, por otro, es más probable reducir el estigma, la dramatización y la culpabilización de las víctimas por participar, aspectos que actúan como barreras para su prevención (por ejemplo mediante la ocultación) y amplifican el impacto, sobre todo, en las chicas29,240,248.

Contactos y Conductas

Hay que diferenciar los riesgos asociados al contacto con adultos, mayormente de carácter delictivo, con los derivados de las conductas que se dan entre menores4,8 (Figura 1).

Entre menores, el ciberacoso (o ciberbullying) es uno de los riesgos más frecuentes y dañinos4,57,58,249. Suele comenzar ya en primaria y está fuertemente ligado al contexto escolar19,250: el 16 % de los menores entre 9 y 16 en España declaran haberlo sufrido19. Sus impactos físicos, psicológicos y académicos están bien documentados4,8,19,251. Aunque suele coexistir con el acoso presencial, la omnipresencia, la mayor audiencia o la deshumanización propias del ciberacoso agravan sus efectos19,252,253. La combinación de ambos genera una victimización constante y efectos más duraderos, por lo que es prioritario actuar (Cuadro 3) sobre los comentarios y conductas que lo generan.

Otros riesgos habituales entre adolescentes son la participación en retos virales peligrosos y el sexting (Cuadro 4). Igualmente, los contenidos y grupos relacionados con autolesiones o la extrema delgadez pueden favorecer el efecto contagio de la conducta suicida254 (INFORME C)218 o trastornos alimentarios, entre otros aspectos negativos, sobre todo, en personas menores con poco apoyo en su entorno6,21,67. Se estima que un tercio de las personas menores que se autolesionan comparten contenido en línea al respecto255. No obstante, también hay evidencia de que algunos adolescentes encuentran en estos espacios alivio, comprensión y apoyo8,21,256. Otros riesgos, como el reclutamiento en actividades delictivas o extremistas requieren especial atención en el contexto nacional257; es necesario seguir ampliando la evidencia disponible al respecto4,8.

Respecto a los contactos, relacionarse con desconocidos es una práctica común: en España, lo hacen un 20 % de los niños y niñas con 9-11 años y un 66 % entre los 15 y 1619. Aunque muchas de estas interacciones no tienen consecuencias negativas8,19, los menores no siempre están preparados para poder gestionar situaciones potencialmente peligrosas258.

De forma general, preocupa el aumento en escala, diversidad, gravedad y complejidad de la explotación y el abuso sexual infantil en línea, facilitado a través de redes sociales y servicios de mensajería4,27,57,259. Incluye riesgos como el grooming, la solicitud sexual, la sextorsión o el acoso sexual, entre otros8,57,259. Todos los delitos sexuales mediados por tecnología contra menores de 16 años han aumentado260,261, hasta 5 veces en 10 años27. Los estudios de prevalencia de victimización por abuso sexual en línea19,262–264 muestran cifras dispares según edad, sexo y grupo social entre los menores: desde un 9,6 % entre los 12-13 años hasta un 25,6 % entre los 16-17, con mayor incidencia en chicas, personas LGTBIQ+ y minorías raciales4. Por otro lado, informes recientes indican que el 97 % de las personas entre 18 y 21 años en España consideran que han sufrido algún tipo de violencia sexual digital cuando eran menores (UNICEF)242. Otros informes colocan la cifra en el 60,6 % para la franja de los 16 a los 29 años (FAD juventud)259. La recepción de contenido sexual no consentido y el acoso por el aspecto físico destacan por ser las formas de violencia sexual que más se repiten259.

Aunque se trata de fenómenos recientes, la investigación sobre las dinámicas de acoso y abuso y los factores de riesgo ha crecido242,263. Sin embargo, en algunos casos, como ocurre con la sextorsión, aún faltan datos fiables8.

Los riesgos asociados a conductas y contactos no son categorías aisladas: suelen combinarse y retroalimentarse amplificando los efectos adversos265–267. De hecho, un porcentaje significativo acumula múltiples formas de victimización en línea simultáneamente (más habitualmente las chicas)265,268. Por ejemplo, ciberacoso y grooming, seguido de ciberacoso y sexting no consensuado (Cuadro 4), son los binomios más habituales268, aunque la misma víctima puede estar expuesta a las tres prácticas mencionadas. En ocasiones, se pueden sumar otras como la violencia en la pareja a través de conductas comunes en las que cambia el perpetrador (compañeros, su pareja o un adulto)267,268. Además, en fenómenos como el acoso, las figuras de víctima, agresor y observador pueden solaparse o alternarse, lo que favorece la normalización y persistencia de la violencia u otros riesgos269–271. Por todo ello, la comunidad experta subraya la importancia de intervenir sobre las tres figuras9 y abordar los riesgos en línea (Figura 1) como fenómenos psicosociales que requieren respuestas coordinadas desde la salud, la educación, la protección y la justicia.

Contrato, privacidad y explotación comercial

Los perfiles digitales de niños, niñas y adolescentes son altamente valiosos para las plataformas, ya que permiten establecer vínculos de consumo desde edades tempranas33,205. Se trata de una clientela especialmente influenciable (Cuadros 1 y 2), con menor capacidad crítica para identificar o resistir mensajes comerciales, y con poder prescriptor en el entorno familiar8,27. A menudo, la publicidad es aceptada si resulta entretenida, ya sea por presión de grupo, comodidad o indiferencia272,273.

Los riesgos comerciales se pueden concretar en la exposición a publicidad inapropiada (como alcohol)4 o encubierta, en especial, mediante influencers y kidinfluencers54, gamificación o entretenimiento, sin reconocer explícitamente su carácter publicitario y persuasivo273–276. Los anuncios sobre alimentación o productos ligados a la imagen física (ropa, maquillaje), presentados con una estética aspiracional, son los que los menores identifican como más comunes277. Se suman también riesgos económicos derivados de fraudes4. Estas estrategias dificultan el desarrollo de una mirada crítica278 y se asocian con impactos negativos severos sobre derechos fundamentales.

Así, el modelo de negocio de las redes sociales (Cuadro 2) compromete el derecho a la vida privada y normaliza la explotación comercial de los menores de edad279. En estos entornos, no solo consumen contenido: los usuarios generan datos (personales, que incluye las imágenes, derivados de su interacción u otros tipos) que los convierten en producto, al cederlos, consciente o inconscientemente, a plataformas y terceros cuyas intenciones son desconocidas58. A veces, por otra parte, son los propios padres los que exponen a los menores en las redes54,280 (Cuadro 5).

La mercantilización de los datos de niños, niñas y adolescentes da lugar a relaciones comerciales poco transparentes, legal180,294 y éticamente cuestionables179,295,296. Preocupan especialmente prácticas como el perfilado conductual o la segmentación basada en emociones o trayectoria personales (Cuadro 2), ya que contravienen su derecho a no ser explotados económicamente (art. 32 CDN)27,37 y pueden ser especialmente perjudiciales para los menores297. La comunidad experta destaca la fuerte asimetría a la que se enfrentan las personas menores (falta de información, falta de alternativas ante los monopolios, pues la redes disponibles mayoritarias son las que son, un fuerte deseo de pertenencia y la presión de los pares, etc.) y cuestiona la eficacia del marco normativo actual y de la autorregulación22,298. Se critica especialmente la recopilación y tratamiento de datos de carácter masivo justificada, a veces, en la disponibilidad de herramientas insuficientes por sí solas para la protección, como el control parental, lo que puede dejar sin garantías suficientes a la persona menor30,299. Otras, como el consentimiento en el tratamiento de datos de menores22, es también cuestionada dada la dificultad de los menores y familias para comprender sus implicaciones7,64,300, lo que podría limitar el ejercicio de sus derechos3,301.

Cuadro 5. Sharenting, kidinfluencers, influencers… la infancia expuesta

La publicación de imágenes o información sobre los hijos, o sharenting, suele justificarse por el rol de los padres como representantes legales, aunque este tiene limitaciones e implica también la responsabilidad de proteger su privacidad54. En España, un 24 % de los adolescentes afirma que sus padres compartieron información sobre ellos sin su consentimiento, mientras la media Europa es del 20 %19. Un 16 % ha solicitado su retirada y un 11 % y 4 % señalan haberse sentido molestos o haber recibido comentarios dañinos, respectivamente19. Además, el consentimiento dado por un menor no garantiza que, al crecer, mantenga la misma percepción sobre su privacidad19.

El sharenting contribuye a crear una huella digital duradera, muchas veces fuera del control familiar, que puede incluir imágenes sin consentimiento o datos que permiten la geolocalización54,281, entre otros muchos riesgos71. El 72 % de los agresores sexuales a menores posee imágenes de niños sin contenido sexual explícito282, lo que evidencia los riesgos de compartir este tipo de contenido. Tecnologías como la inteligencia artificial agravan el problema, al facilitar la generación de deepfakes pornográficos, un aspecto que requiere regulación específica (INFORME C)169, o la geolocalización de imágenes4.

La exposición se intensifica en perfiles de instamadres o kidfluencers, donde la presencia de menores se vincula a dinámicas de explotación comercial283,284, normalmente bajo el pretexto del entretenimiento274. Las publicaciones con menores obtienen un 41 % más de interacciones, lo que refuerza su uso como recurso de atracción285. En la otra dirección, muchos influencers son conscientes de su capacidad de influencia sobre los menores y actúan acorde a ello con los riesgos que implica: pueden promover aspectos como la salud física o mental o afectarla negativamente, promover cambios ideológicos y un largo etcétera54,276,286,287.

Desde el ámbito legal, el ordenamiento jurídico aplicable en España (como el RGPD, entre otros) protege al menor frente la difusión pública de datos privados288. Así, aunque existen medidas que aplican en el contexto del sharenting288,289, algunos expertos advierten de un vacío legal y una mayor necesidad de acciones específicas y concienciación sobre sus riesgos37,54,288,289. En este sentido, países como Francia, ya han avanzado hacia regulaciones concretas sobre este fenómeno290. Respecto al fenómeno influencer, aunque existe una ley que regula su actividad291, la comunidad experta señala que su alcance es limitado y refieren el modelo francés292 como más exigente y completo. A nivel europeo se han revisado las regulaciones existentes sobre el fenómeno y se destaca la importancia de actuar atendiendo a su naturaleza de prestadores de servicios de comunicación audiovisual (como los medios de comunicación) y a la normativa de protección de los consumidores, a la que también están sujetos293. Se prevé que la futura Ley de Equidad digital europea (en fase de consulta abierta) ahonde en los riesgos asociados al marketing engañoso por parte de influencers189.

La Ley de Servicios Digitales222 prohíbe algunas de las prácticas señaladas, como el perfilado. Sin embargo, con anterioridad a la reciente publicación (junio de 2025) de los códigos de actuación de la norma226 (Cuadro 3), algunos trabajos académicos han sugerido que los mecanismos previstos podrían ser insuficientes para su aplicación efectiva297. Se espera una mayor regulación de las prácticas de personalización desleales mediante la futura Ley de Equidad digital europea (en fase de consulta abierta por el momento)189.

Impactos sobre el bienestar y la salud

Aunque la mayoría de adolescentes utiliza las redes sociales sin consecuencias graves, una parte significativa sí experimenta efectos adversos10. De forma general, la gran variedad de efectos negativos relacionados abarcan desde problemas emocionales (internalización; como baja autoestima, depresión, etc.) o de conducta (externalización; comportamientos disruptivos, agresivos, impulsivos, etc.) hasta aspectos vinculados al deterioro del entorno social, familiar o escolar15,302–306.

El estrés digital describe el malestar que sufren niñas, niños y adolescentes al interactuar en redes sociales u otros contextos digitlaes40. No es un fenómeno único, sino un conjunto de tensiones y presiones derivadas del diseño y uso de estas plataformas, que fomentan la vigilancia, la ansiedad constante y otros efectos negativos. Abarca desde aspectos como la humillación pública, la presión por estar siempre disponible, el FOMO, la ansiedad por aprobación y la sobrecarga comunicativa, hasta consecuencias derivadas del ciberacoso40,307. Estas formas de estrés se asocian con menor bienestar, síntomas depresivos, problemas de sueño y una intensa presión social. También es común que los adolescentes rumien sobre sus experiencias digitales, pensando frecuentemente en interacciones o contenidos que ocurrieron en línea.

Entre los múltiples impactos sobre la salud mental relacionados con el uso de redes sociales por parte de la población adolescente, aquellos que cuentan con mayor evidencia son21: uso problemático154, depresión y ansiedad (sobre todo, vinculado a ciberacoso308,309, comparación social, FOMO o doomscrolling6,21,165), autolesiones y conducta suicida6,21,67 (INFORME C)218, trastornos alimentarios y asociados a la imagen corporal (es además el impacto con mayor sesgo de género140–143,154,157), y la alteración de aspectos conductuales, afectivos y sobre la construcción de valores. Este último punto incluye desde mayor agresividad, conductas sexuales problemáticas, desinformación (INFORME C)169 y desafección democrática8,310 hasta el impacto traumático de las distintas formas de abuso o de la difusión no consentida de imágenes íntimas, reales o falsas8.

A nivel físico, la alteración del sueño es el efecto pernicioso que cuenta con evidencia más clara21,90 ya que el uso nocturno de redes y pantallas, el uso intensivo, el FOMO y el estrés digital afectan a la calidad y duración sueño. Por su parte, la falta de sueño, incide en todos los aspectos de la salud12,21,90,311 y otros parámetros, como peores resultados académicos154. De hecho, aunque estos se han asociado negativamente con el uso excesivo de redes sociales, se requiere reforzar la evidencia al respecto para poder establecer causalidad154,312,313. Existe también cierta evidencia que señala que el uso de redes puede desplazar la actividad física6,70. Otros efectos físicos relacionados como cambios en el desarrollo cerebral (especialmente las áreas relacionadas con el control de impulsos y las emociones) requieren de más estudios y refuerzos metodológicos para poder ser concluyentes12,21,68,314.

La protección de las personas menores en redes sociales

Responsabilidad

Organismos como el Comité de los Derechos del Niño27, la Comisión Europea o el Consejo de Europa315 subrayan que los Estados tienen la responsabilidad de garantizar mediante la regulación entornos digitales seguros y adaptados a la edad. Para ello, proponen un enfoque integral que involucre a gobiernos, plataformas, educadores, familias y sociedad civil4–7,66,75,316.

El personal experto e instituciones como la Organización para la Cooperación Económica y el Desarrollo (OECD) destacan que de forma generalizada las respuestas legislativas actuales pueden considerase fragmentadas, dispersas y requieren mayor coordinación entre organismos y sectores7,61,67,317. Señalan la importancia de avanzar hacia una regulación específica, flexible y coherente centrada plenamente en los derechos de las personas menores y en los desafíos digitales, que reduzca la dispersión actual existente en la materia7,30,66. Además, persisten vacíos normativos y dificultades de aplicación, en especial, en lo relativo al diseño de plataformas, la publicidad dirigida o la protección frente a prácticas manipulativas22,27,33,205 (Cuadro 2). Asimismo, se cuestiona el alcance real de la autorregulación6,7. Ante este panorama, la comunidad experta subraya la importancia de una mayor coordinación institucional y la creación de organismos de supervisión independientes, con recursos, autoridad y mecanismos para evaluar o verificar los riesgos y la seguridad de las plataformas, así como la eficacia de las políticas públicas7. Todos estos aspectos pueden favorecer el avance hacia una regulación coherente, centrada en los derechos del menor y adaptada a los desafíos del entorno digital7,318.

Las prácticas que conllevan riesgos y efectos adversos en las redes sociales no deben asumirse como inevitables30,43,299. Desde la perspectiva regulatoria, existen dos grandes grupos de actuaciones complementarias en las que conviene avanzar paralelamente. Por un lado, normas dirigidas a los prestadores de servicios, que son los principales responsables de sus productos y los daños que puedan causar27,319. Pueden orientarse a la protección ante riesgos específicos, como puede ser Ley General de Comunicación Audiovisual207 frente a contenidos dañinos para el menor, o estructurales, como el Reglamento General de Protección de datos o la Ley de Servicios Digitales. Estas últimas ponen el foco en un aspecto fundamental: que las compañías garanticen servicios seguros por diseño y defecto para priorizar el bienestar infantil sobre otros intereses5,6,75,320. Por otro lado, las políticas públicas son el marco para construir una sociedad más preparada y resiliente a los riesgos en línea (sección Una sociedad resiliente)4,27. Esto no debe implicar que aspectos como el acompañamiento, el control o la mediación parental, la concienciación o el desarrollo de habilidades digitales, entre otros, trasladen la responsabilidad sobre la seguridad a las familias, escuelas o el propio menores, pues radica en las plataformas.

La literatura científica señala que la evidencia empírica sobre la efectividad de las intervenciones y regulaciones en el campo de las redes sociales pueden considerarse, en términos generales, incipiente y necesita ser fortalecida4,66,75. Esto pone de relieve la importancia de evaluar rigurosamente todas las intervenciones que se desarrollan y aplican, tratándolas como experimentos naturales40,75. Un ejemplo es la reciente prohibición del uso de redes sociales por menores de 16 años en Australia o los avances en la moderación de contenidos en Reino Unido, cuyas implementaciones deben ser analizadas con atención para diseñar los siguientes pasos (Cuadro 3). De hecho, en los últimos años se han impulsado múltiples estrategias e intervenciones orientadas a la protección de las personas menores en redes sociales e internet4,40,75. En el contexto español, destaca particularmente el reciente conjunto de medidas elaborado por el Comité de Personas Expertas para el desarrollo de un entorno digital seguro para la juventud y la infancia27.

Redes seguras y adecuadas a la edad por diseño y defecto

Hasta el momento, las estrategias de seguridad de las plataformas se han centrado en un enfoque reactivo. Es decir, los menores quedan expuestos a los riesgos mencionados y se actúa cuando se detecta un daño o infracción concreta43. Otra estrategia extendida es la creación de espacios o alternativas a los servicios enfocadas exclusivamente en menores, algo desaconsejado por permitir su clara identificación y generar un “efecto pecera” que puede favorecer la concentración de actores maliciosos, la explotación comercial de sus datos o cualquier otro riesgo43. La medida preferida para reducir la exposición a los riesgos, garantizar la privacidad y, en definitiva, proteger el interés superior del menor es la construcción de entornos digitales (redes sociales, plataformas, servicios o, de forma genérica, un internet) seguros por diseño y por defecto. Esto implica que las medidas de protección se integren desde el diseño sin requerir ningún tipo de acción del usuario43,321, en línea con la Ley de Servicios Digitales u otras normas internacionales, como la Online Safety Act del Reino Unido (Cuadro 3). No obstante, la comunidad experta destaca la importancia de aumentar los esfuerzos y el cumplimiento de los proveedores de servicios en esa dirección4,8,27.

Coordinación, cooperación y transparencia como principio rector

La visión regulatoria europea se ha basado históricamente en valores como la apertura, la inclusión y la transparencia322. Sin embargo, la comunidad experta considera que el compromiso del sector digital con estos principios y la seguridad por diseño y defecto no es homogéneo y es en muchos casos bajo27. Las medidas adoptadas, como normas internas, medidas voluntarias y autoregulación, control parental o filtros, se consideran insuficientes27. Es necesario reforzar el compromiso de las plataformas y, si el cumplimiento falla, revisar y considerar medidas más firmes incluyendo la capacidad de sanción6,7, lo que requiere también de coordinación entre estados para garantizar un marco regulatorio común y sólido.

La protección del menor en redes sociales requiere que las plataformas colaboren activamente y replanteen el modelo de negocio ante sus posibles efectos negativos. Para ello es necesario que compartan datos con la comunidad científica, informen sobre el riesgo e impacto de sus servicios y avancen en transparencia algorítmica y moderación de contenidos ilegales y dañinos, de forma proactiva y actuando con rapidez y abiertamente cuando son detectados7,40,44,323. Esta cooperación es esencial para generar conocimiento útil y construir entornos digitales más seguros. La agilidad y el compromiso real de las plataformas son necesarios para prevenir daños y garantizar una protección efectiva.

Rediseñar para la seguridad y el bienestar

La Ley de Servicios digitales dedica su artículo 28 a la protección de los menores en las plataformas digitales y establece cómo las plataformas deben avanzar hacia un diseño seguro por defecto ajustado a la edad (Cuadro 3). Existen también guías a nivel nacional30,43,299 e internacional315,321,324,325 que, en algunos casos, incluyen directrices para abordar desde el diseño los derechos digitales de las personas menores (Figura 2). Se destaca así la importancia de que las grandes plataformas incorporen este enfoque en su oferta de servicios. En cuanto al diseño persuasivo de las redes (Cuadro 2), la UE también propone eliminar funciones como el scroll infinito o el “me gusta”187, apostar por configuraciones seguras y fáciles de usar o reducir por defecto el número de notificaciones para evitar el uso excesivo75.

La trazabilidad debe ser parte central del rediseño: la regulación europea destaca la importancia de documentar y compartir abiertamente estos procesos (como los test A/B, u otros aspectos que dirijan las decisiones)327. Como en protección de datos, las plataformas deberían dejar constancia de sus decisiones, objetivos y adecuación a estándares de seguridad infantil. Esto supone un cambio de paradigma: que las plataformas demuestren la seguridad de sus productos antes de lanzarlos58. Así se avanza hacia una gestión de riesgos centrada en las personas menores, con auditorías independientes por edad y grupo social5–7 (ver Cuadro 3). Aunque muchas empresas prueban sus diseños a gran escala, no comparten los resultados ni los orientan al interés público6,40. La trazabilidad afecta también a la recomendación algorítmica, ya que sigue habiendo una falta de alternativas transparentes y diseñadas para menores que garanticen el filtrado de contenidos inapropiados.

Control parental y aplicaciones de bienestar digital

Las aplicaciones de control parental buscan regular el uso de redes sociales mediante límites de tiempo y alertas, filtrado de sitios y contenidos, u otras funciones. Estas pueden estar integradas en las propias plataformas, en aplicaciones externas o en los dispositivos (informes de tiempo de pantalla, modos “escuela” o “concentración”, temporizadores, alertas por uso excesivo, etc.). Sin embargo, la evidencia sobre su efectividad es limitada75 y muchas de estas medidas pueden ser fácilmente eludidas por los adolescentes. Por ejemplo, solo una de 23 revisiones ha detectado mejoras en indicadores de depresión al limitar el uso de redes sociales88,328 y los estudios disponibles son escasos y con resultados poco concluyentes75. A pesar de ello, estas herramientas pueden ser útiles para aumentar la fricción y favorecer el autocontrol, si se adaptan a la edad y se integran en un enfoque más amplio que incluya acompañamiento familiar y promoción del bienestar digital. En este contexto, la mediación parental emerge como un elemento clave que va más allá del control técnico: abarca el diálogo, la educación digital y el acompañamiento activo en el uso responsable de las tecnologías329,330 (sección Estrategias para el bienestar digital).

Edad de acceso, contenidos adecuados y sistemas de verificación